티스토리 뷰

반지도 학습 도메인을 Generalize 시켜서 Person 재-식별화를 시켰다는 논문이다.

음 이논문에서 특별했던 점은 반-지도, 즉 학습을 잘 시킨 모델을 통해서 일부분의 데이터를 추론하는데, 그 추론 데이터를 학습데이터로 활용하여 학습을 돌렸다는 점이다. 그리고 그것이 유의미했다는 것을 실험결과를 통해 증명하였다. Data Diversity가 달랐던 걸까? teacher model은 Resnet101, 학생은 Resnet50 이었다.

주개념

Knowledge Distillation

- 선생이 가진 loss를 minimizing 하는 function 을 학생하게 전달함으로 써 선생못지않거나 선생을 능가하는 학생모델을 만든다고 한다. 이 Knowledge Distillation 에는 3가지 방식이 있따. 1번째는 response-based knowledge knowledge distillation 이라고 하는 건 선생모델로써 아주 거대하고 깊은 logis를 사용한다는 것이다.

2. Feature-based knolwedge distillation 은 활성화 함수나 뉴론 혹은 =중간층의 featrue 들을 선생으로써 활용한다.

3. Relationship -based knoledge distillation 은 보다 활성화가 얼마나 다른지 뉴런이나 sample 의쌍이 렁마나 다른지를 파악해 이것을 확장하고 explore 하는 개념이다.

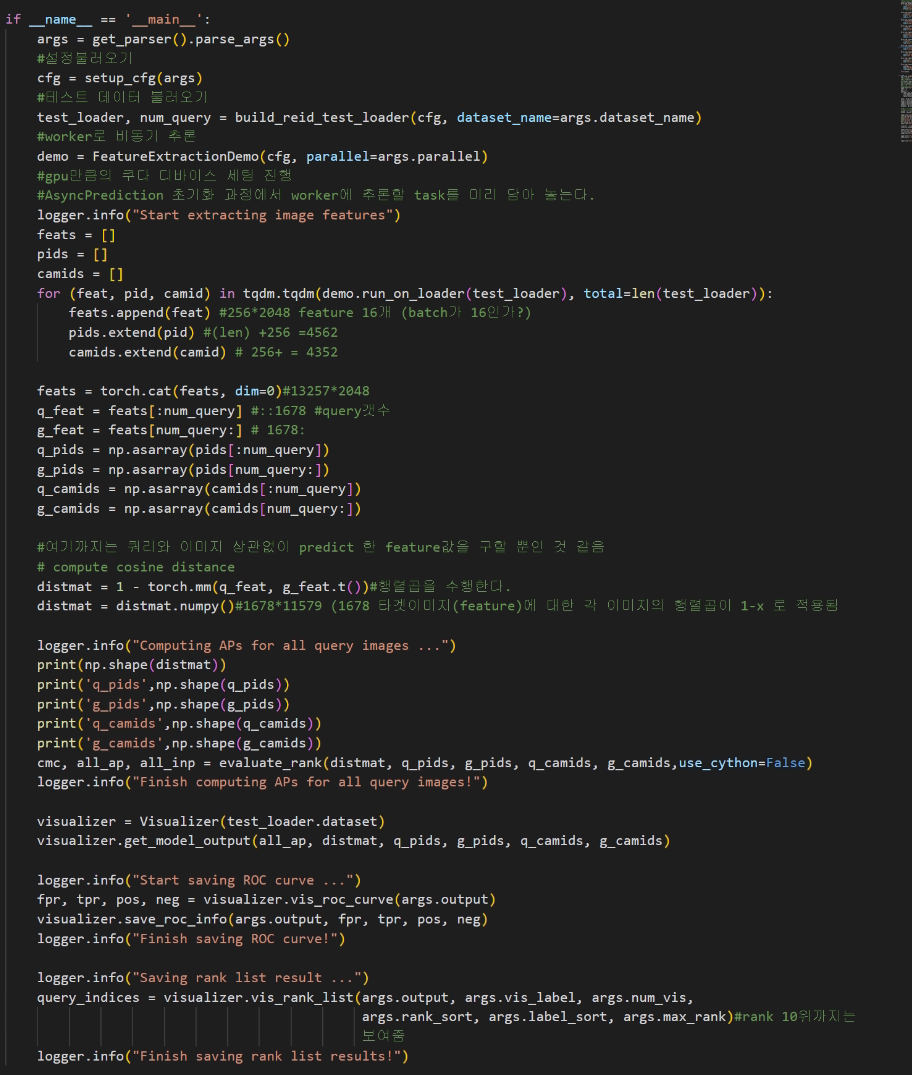

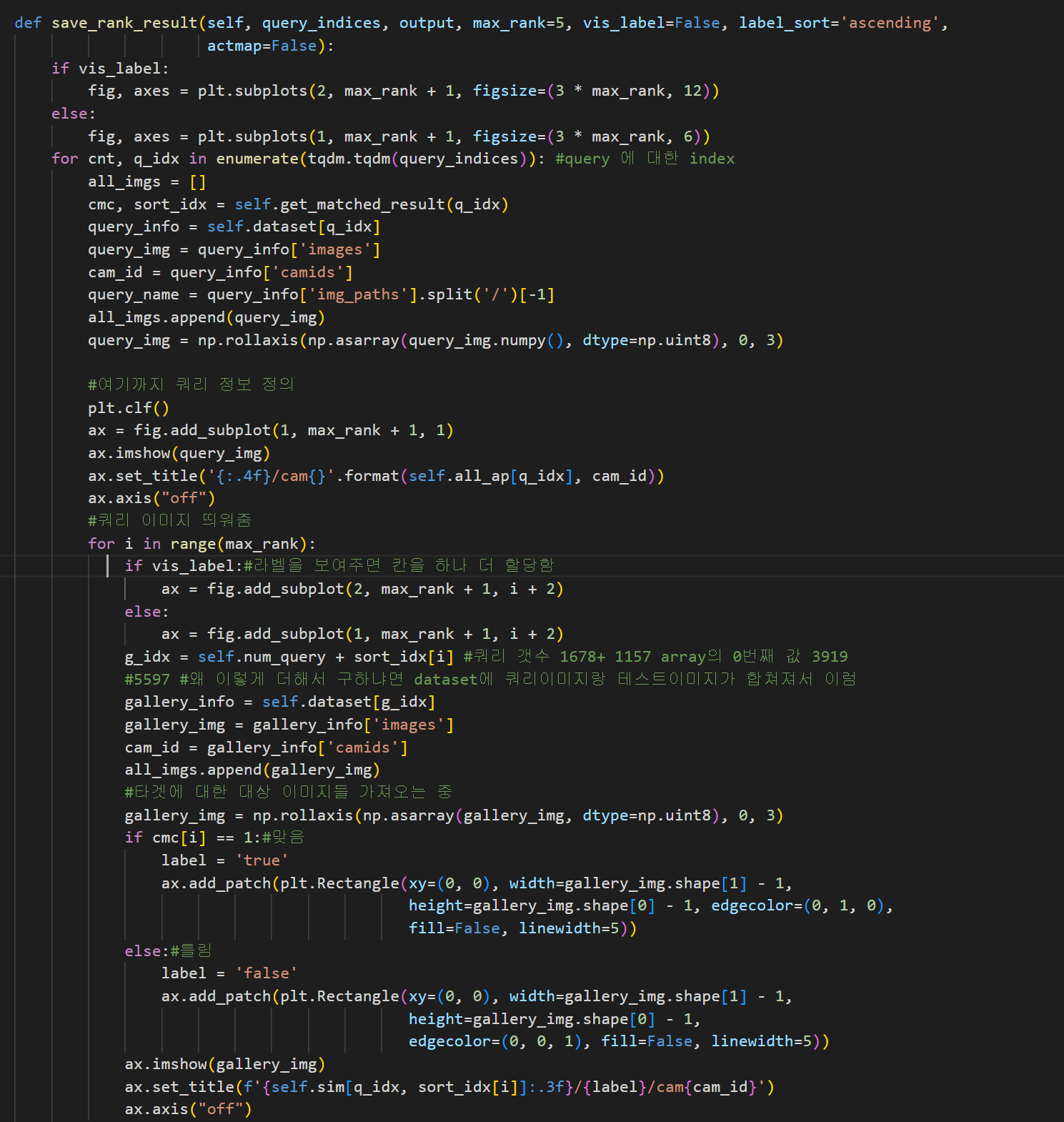

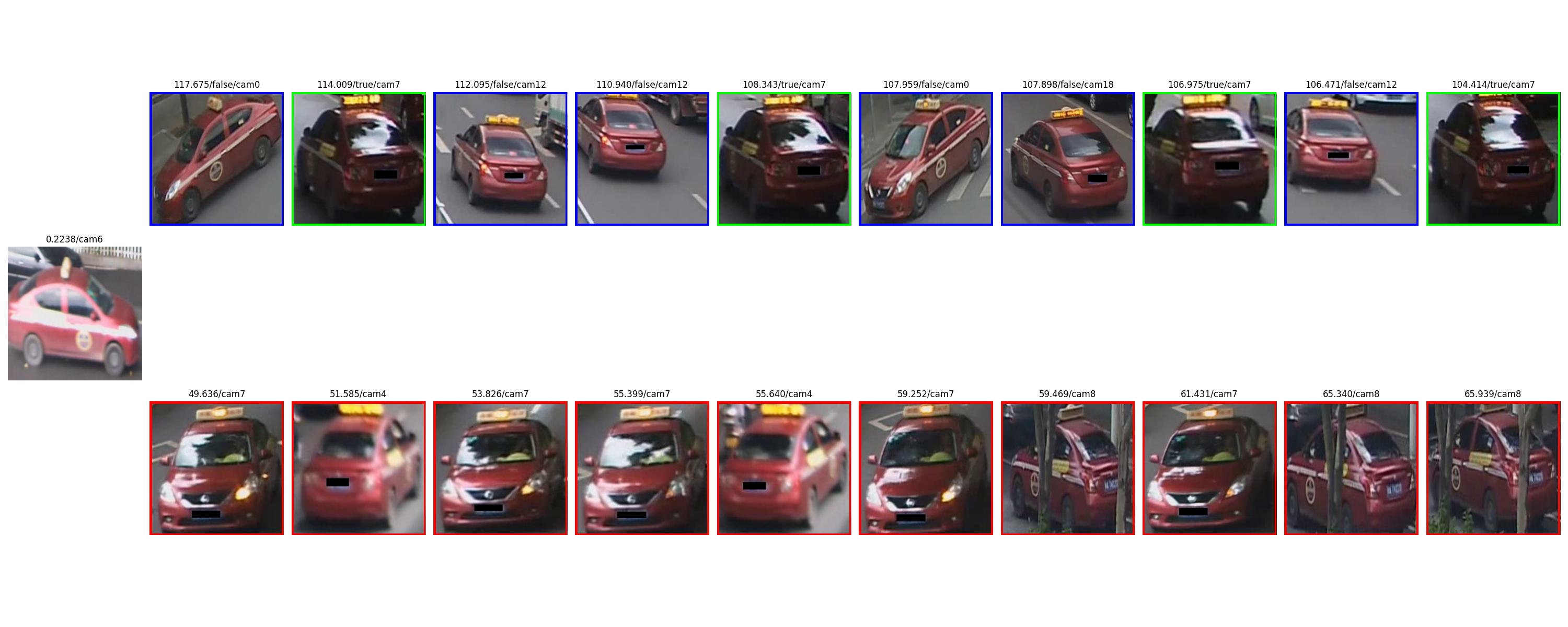

흠. 논문을 통해서 익힌 것은 이정도였고 코드는

'AI > 주워들은 것들' 카테고리의 다른 글

| Virus Detection is Undecidable (0) | 2023.10.03 |

|---|---|

| Attention 다시 보기 (0) | 2023.09.20 |

| Siamese network(샴 네트워크) (0) | 2021.11.09 |

| Transfer Learning (0) | 2021.11.07 |

| INF란 무엇인가 (0) | 2021.05.30 |

공지사항

최근에 올라온 글

최근에 달린 댓글

- Total

- Today

- Yesterday

링크

TAG

- max-margin_loss

- textual guidance

- Group Acitivty Recognition

- 샴네트워크

- torchmodel

- yolov3 #tensorflow_convert

- batch란

- /var/log/tallylog

- Chatgpt4

- DetectoRS

- 도메인 어댑테이션

- Source-free unsupervised domain adaptation

- Deformable Part Model

- tf2to1

- tensorflow convert

- StyleCLIP

- /var/log/fontconfig.log

- /var/log/alternatives.log

- 1-stage detection

- TransferLearning

- 첫논문

- 딥페이크탐지

- alternatives.log

- Deformable Convolutional Networks

- neural network applications

- 전이학습

- tf version porting

- /var/log/faillog

- Arbitrary image stylization

- ctfloader

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |

글 보관함