AI/주워들은 것들

Semi-Sumpervised Domain Geneeralizable Person Re-Identification

아인샴

2022. 9. 4. 20:20

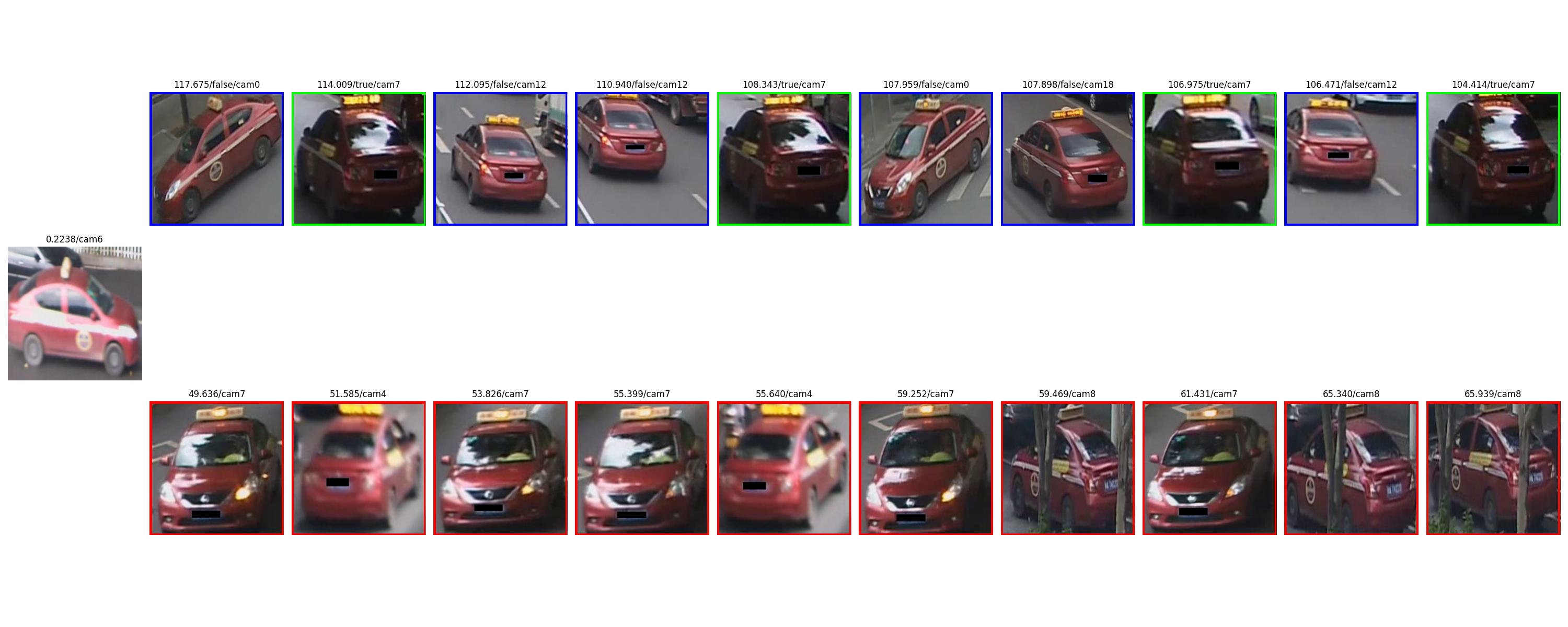

반지도 학습 도메인을 Generalize 시켜서 Person 재-식별화를 시켰다는 논문이다.

음 이논문에서 특별했던 점은 반-지도, 즉 학습을 잘 시킨 모델을 통해서 일부분의 데이터를 추론하는데, 그 추론 데이터를 학습데이터로 활용하여 학습을 돌렸다는 점이다. 그리고 그것이 유의미했다는 것을 실험결과를 통해 증명하였다. Data Diversity가 달랐던 걸까? teacher model은 Resnet101, 학생은 Resnet50 이었다.

주개념

Knowledge Distillation

- 선생이 가진 loss를 minimizing 하는 function 을 학생하게 전달함으로 써 선생못지않거나 선생을 능가하는 학생모델을 만든다고 한다. 이 Knowledge Distillation 에는 3가지 방식이 있따. 1번째는 response-based knowledge knowledge distillation 이라고 하는 건 선생모델로써 아주 거대하고 깊은 logis를 사용한다는 것이다.

2. Feature-based knolwedge distillation 은 활성화 함수나 뉴론 혹은 =중간층의 featrue 들을 선생으로써 활용한다.

3. Relationship -based knoledge distillation 은 보다 활성화가 얼마나 다른지 뉴런이나 sample 의쌍이 렁마나 다른지를 파악해 이것을 확장하고 explore 하는 개념이다.

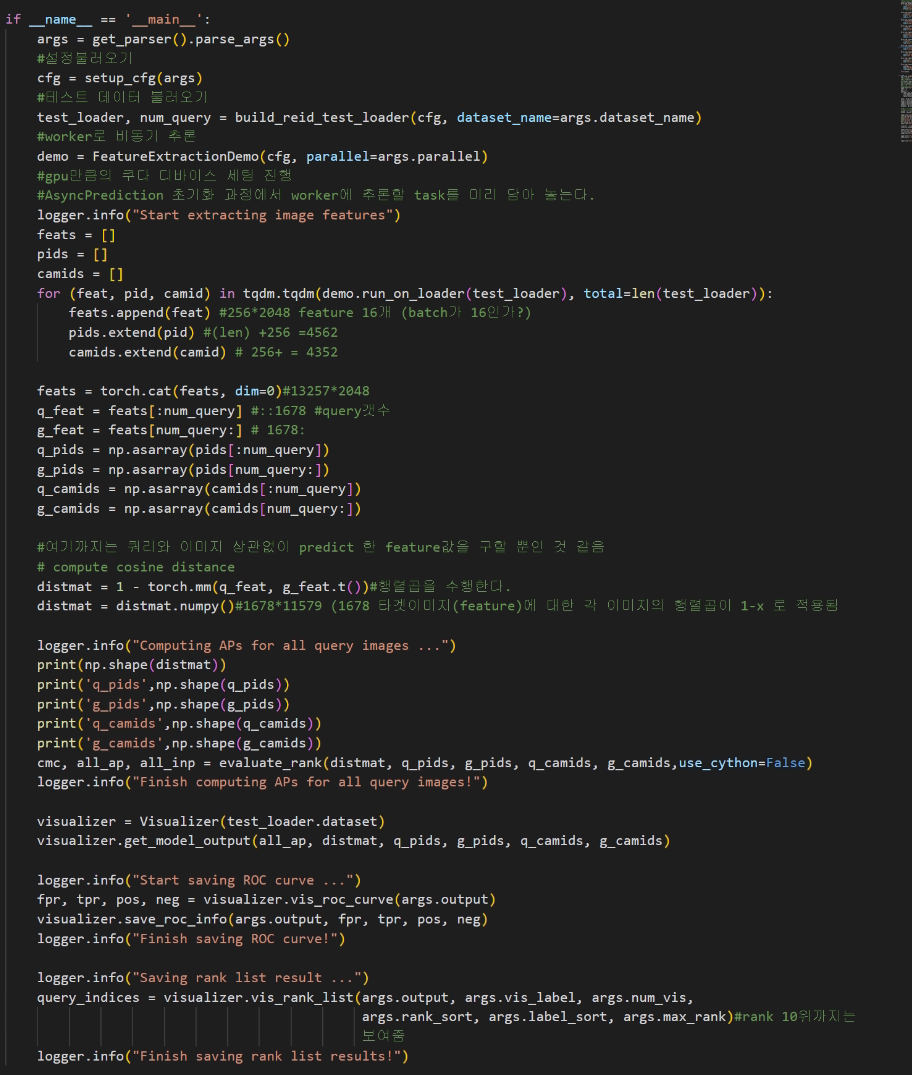

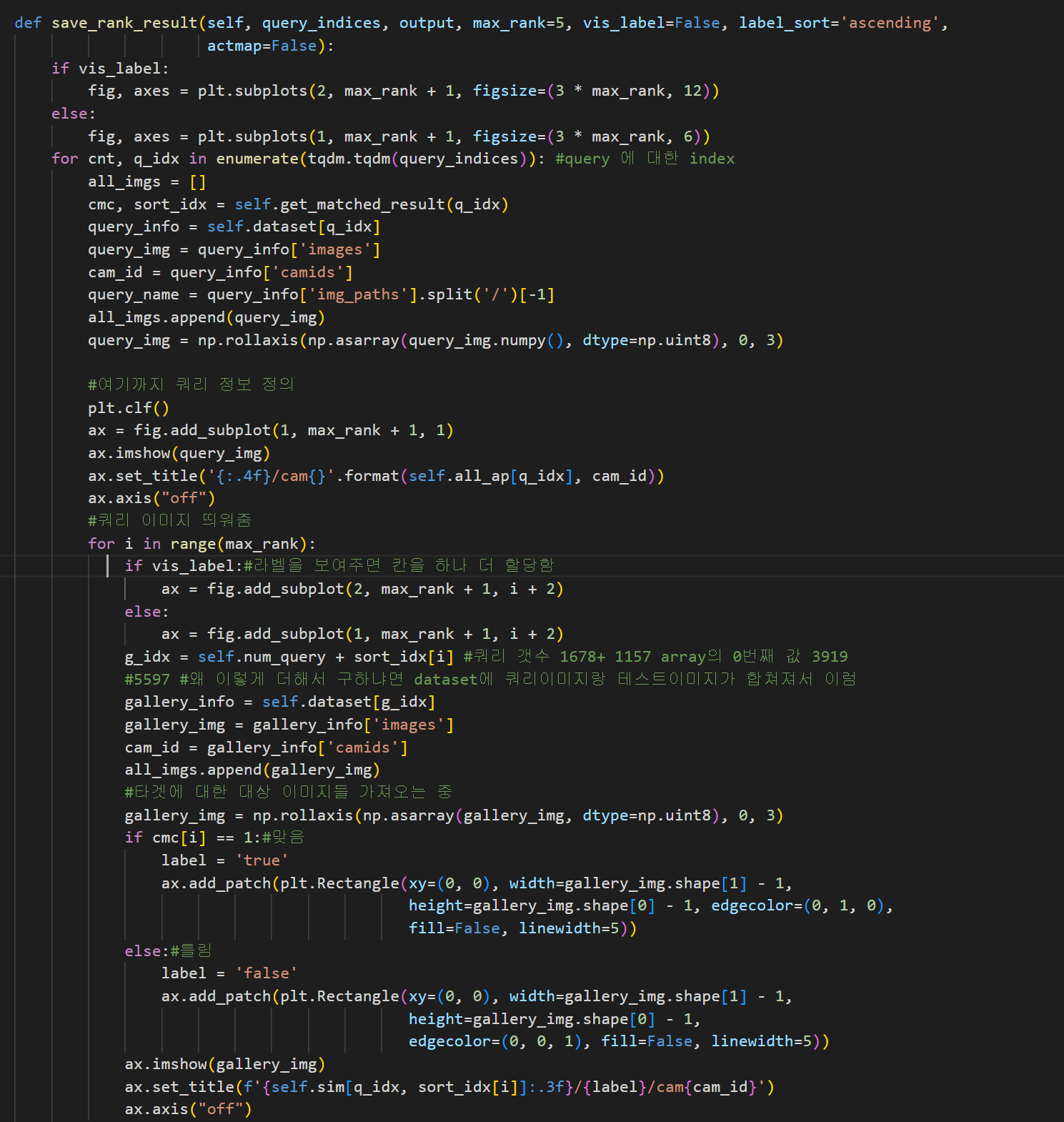

흠. 논문을 통해서 익힌 것은 이정도였고 코드는